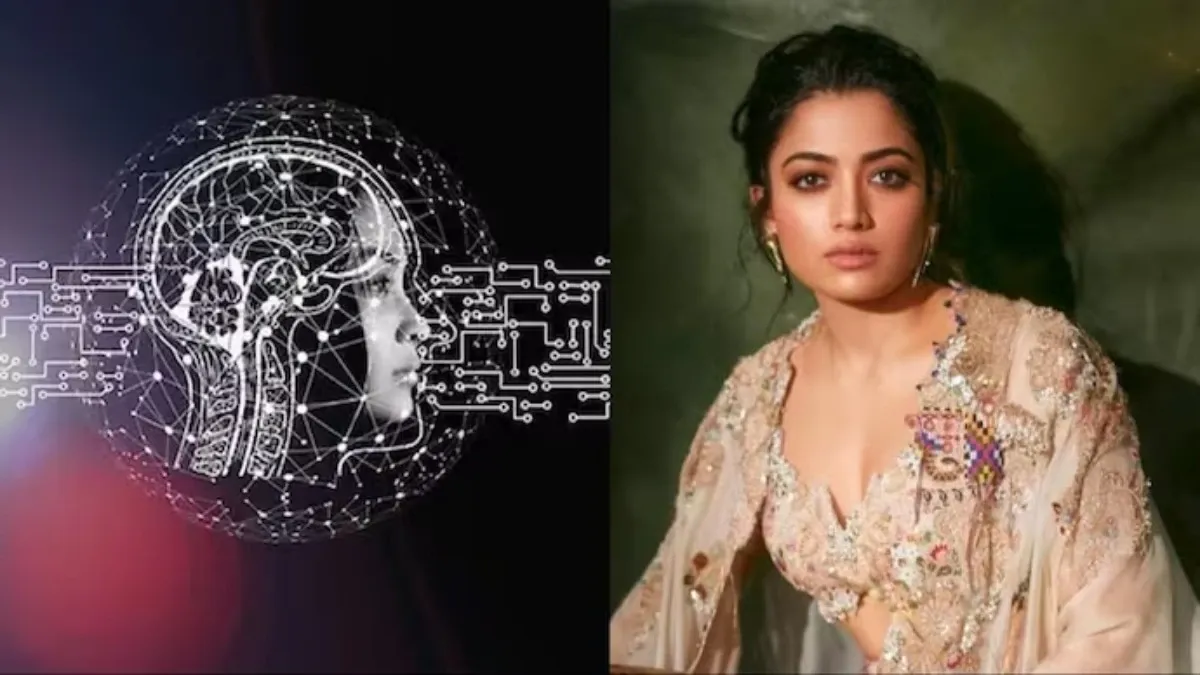

डीपफेक तकनीक : एआई से तैयार फर्जी वीडियो की बढ़ती समस्या पर रोक को लेकर बहस तेज

नई दिल्ली। पहले रश्मिका मंदाना और फिर कटरीना कैफ। कृत्रिम बुद्धिमत्ता (एआई) तकनीक से तैयार दोनों अभिनेत्रियों के फर्जी वीडियो ने पिछले हफ्ते तहलका मचा दिया था। इस विवाद ने डीपफेक तकनीक का दुरुपयोग रोकने और फर्जी वीडियो की पहचान के लिए बेहतर प्रौद्योगिकी विकसित करने की जरूरत को नये सिरे से उजागर किया है।

दिल्ली पुलिस ने जहां शुक्रवार को रश्मिका के डीपफेक वीडियो के संबंध में अज्ञात लोगों के खिलाफ प्राथमिकी दर्ज की, वहीं अमिताभ बच्चन और केंद्रीय मंत्री राजीव चंद्रशेखर सहित अन्य लोगों ने इस तकनीक के दुरुपयोग पर चिंता जाहिर की है। सरकार ने प्रमुख सोशल मीडिया कंपनियों को गलत सूचना, डीपफेक और नियमों का उल्लंघन करने वाली अन्य सामग्री की पहचान करने और रिपोर्ट किए जाने के 36 घंटे के भीतर उन्हें हटाने का परामर्श दिया है।

इजराइल-हमास संघर्ष की पृष्ठभूमि में बहस ने भी कई सवालों को जन्म दिया, जिसमें दुष्प्रचार फैलाने और जनता की राय में हेरफेर करने के लिए डीपफेक वीडियो के इस्तेमाल में वृद्धि देखी गई है। डीपफेक वीडियो क्या होते हैं?

डीपफेक वीडियो सिंथेटिक मीडिया होते हैं, जिनमें मौजूद किसी व्यक्ति की तस्वीर या वीडियो को अन्य व्यक्ति की तस्वीर और वीडियो से बदल दिया जाता है। हालांकि, डीपफेक तकनीक कई वर्षों से मौजूद है, लेकिन हाल में यह तेजी से परिष्कृत और सुलभ हो गई है, जिससे इसके दुरुपयोग को लेकर चिंताएं बढ़ गई हैं।

हम क्या कर सकते हैं?

डीपफेक के प्रसार से निपटने का एक तरीका जनता को इस प्रौद्योगिकी और नकली वीडियो की पहचान करने के तरीके के बारे में शिक्षित करना है। ओपन-सोर्स जांच (ओएसआईएनटी) विशेषज्ञ एवं प्रशिक्षक इओघन स्वीनी ने 'पीटीआई-भाषा' को बताया, "तकनीकी विशेषज्ञता या क्षमताओं से कहीं अधिक एक मानसिकता है, जिसे प्रोत्साहित करने की जरूरत है।

लोगों को जागरूक करने की आवश्यकता है कि नकली सामग्री का निर्माण बड़े पैमाने पर हो रहा है और यह दिन बदिन आसान होता जा रहा है।" स्वीनी ने कहा, "इसीलिए मौजूदा परिदृश्य जैसे भयावह माहौल में, यह जानना महत्वपूर्ण है कि आप तक बड़े पैमाने पर पहुंचने वाली जानकारी एवं सामग्री अप्रामाणिक है।"

कुछ सलाह

डीपफेक का पता लगाने के लिए कई टूल और उपायों का इस्तेमाल किया जा सकता है, जैसे कि चेहरे के हावभाव, त्वचा की रंगत और प्रकाश व्यवस्था में विसंगतियों की पहचान करना। हालांकि, डीपफेक तेजी से परिष्कृत होते जा रहे हैं, जिससे उन्हें पहचानना अधिक कठिन हो गया है। उन संकेतों पर ध्यान दें, जो यह अंदाजा देते हैं कि सोशल मीडिया पर साझा किए जा रहे वीडियो एआई-जनित नकली तस्वीरें या वीडियो हो सकते हैं।

एआई-जनित टेक्स्ट (लिखित) सामग्री कभी-कभी व्याकरणिक रूप से गलत हो सकती है या उसमें अजीब वाक्यांश मौजूद हो सकता है। ऐसा इसलिए, क्योंकि एआई सिस्टम को टेक्स्ट के बड़े डेटासेट पर प्रशिक्षित किया जाता है, जिसमें कभी-कभी ही सही व्याकरण या प्राकृतिक भाषा का इस्तेमाल हो सकता है।

एआई-जनित टेक्स्ट कभी-कभी मुख्य विषय से भटक सकता है या नयी अप्रासंगिक जानकारी पेश कर सकता है। ऐसा इसलिए, क्योंकि यह जरूरी नहीं कि एआई सिस्टम खुद से उत्पन्न टेक्स्ट के संदर्भ को हमेशा ठीक से समझ पाएं। --एआई-जनित फोटो और वीडियो में कभी-कभी असमान्य रोशनी, चेहरे के हावभाव या पृष्ठभूमि हो सकती है।

ऐसा इसलिए, क्योंकि एआई सिस्टम हमेशा सटीक रूप से यथार्थवादी चित्र और वीडियो उत्पन्न करने में सक्षम नहीं हो सकते। --एआई-जनित वीडियो अक्सर अलग-अलग क्लिप को जोड़कर बनाए जाते हैं, इसलिए प्रकाश, छाया या पृष्ठभूमि में विसंगतियां हो सकती हैं। व्यक्ति की त्वचा का रंग एक शॉट से दूसरे शॉट में बदल सकता है या छाया अलग-अलग दिशाओं में हो सकती है।

एआई-जनित वीडियो में मानव गतिविधियों को सटीक रूप से पेश करने में कठिनाई हो सकती है, इसलिए वीडियो में अजीब या असमान्य गतिविधियां नजर आ सकती हैं। वीडियो में व्यक्ति/लोगों का चेहरा विकृत हो सकता है या उनके अंग अजीब तरह से हिलते दिख सकते हैं। एआई-जनित वीडियो की गुणवत्ता अक्सर खराब होती है, खासकर तब जब उन्हें मुफ्त या कम लागत वाले एआई वीडियो जनरेटर का इस्तेमाल करके बनाया गया हो। पिक्सल में बिखराव, धुंधलापन या अन्य विसंगतियों पर नजर डालें।

एआई से वीडियो तैयार करने की तकनीक में लगातार सुधार हो रहा है, इसलिए नवीनतम तकनीक के बारे में जानना अहम है। आप एआई से वीडियो निर्माण पर आधारित लेख और ब्लॉग पढ़कर या सोशल मीडिया पर विशेषज्ञों को 'फॉलो' करके उक्त जानकारी हासिल कर सकते हैं।

सूचना के स्रोत को पहचानें

गलत सूचना कहां से आई? इसे किसने पोस्ट किया? उसकी विश्वसनीयता कितनी है? जानकारी सत्यापित करें। तथ्यों की जांच करें और देखें कि क्या दावे का समर्थन करने के लिए कोई सबूत है। अगर आपको दावे के समर्थन में कोई सबूत नहीं मिल पाता है, तो संभवतः यह सूचना सही नहीं है।

एक बार जब आप सत्यापित कर लें कि कोई सामग्री गलत है, तो स्पष्ट और संक्षिप्त रूप से बताएं कि यह गलत क्यों है। अपने दावों के समर्थन में साक्ष्य उपलब्ध कराना न भूलें। आपका गलत सूचना के प्रसार को रोकना जरूरी है। स्वीनी ने 'पीटीआई-भाषा' से कहा, "सोशल मीडिया एल्गॉरिद्म और मानव मनोविज्ञान जिस तरह से काम करते हैं, उसे देखते हुए सबसे विश्वसनीय सामग्री के आपका ध्यान खींचने की संभावना नहीं होती है, बल्कि उस सामग्री पर ज्यादा नजर पड़ने की गुंजाइश होती है, जो सबसे ज्यादा ध्यान आकर्षित करती है, क्योंकि अक्सर यह नाटकीय और अपमानजनक प्रवृत्ति की होती है।

" बकौल स्वीनी, "यह कहने की जरूरत नहीं है कि उन तकनीकों में दुष्प्रचार को समर्पित वाहक शामिल होते हैं, जो ऐसी प्रतिक्रियाएं उत्पन्न करती हैं। ऐसे में दिमाग और आंखों के बीच लड़ाई में किसी की भी जीत मुश्किल हो जाती है।"

बर्लिन में रहने वाली ओएसआईएनटी विशेषज्ञ स्वीनी ने सुझाव दिया कि किसी फोटो या वीडियो का विश्लेषण करने से पहले लोग कुछ देर रुकें और खुद से सवाल करें। मसलन, यह सामग्री अभी क्यों साझा की जा रही है? यह मुझमें और अन्य लोगों में क्या प्रतिक्रिया उत्पन्न करने की कोशिश कर रही है।

अपनी भावनाओं को देखते हुए, मैं इसे देखने के लिए कितना संवेदनशील हूं? यह सामग्री मेरी भावनाओं को कैसे प्रभावित करती है? (संदेशः आप किसी भी ऐसे दावे या सोशल मीडिया पोस्ट के तथ्यान्वेषण के लिए पीटीआई फैक्ट चेक के व्हाट्सएप नंबर +91-8130503759 पर संपर्क कर सकते हैं, जिसमें मौजूद सामग्री की जांच या सत्यापन किए जाने की जरूरत है।

ये भी पढ़ें : बुजुर्ग ही नहीं युवाओं में भी बढ़ रहा डायबिटीज, ऐसे रखें खास ध्यान

5.png)

6.png)

5.png)

.jpg)

.jpg)